傳統智慧說:「如果你不想讓你的資料被使用,那就退出所有事物。」

我們說: 「既然你的資料終究會被收集,那麼更理性的做法是影響這些資料的使用方式。」

問題不在於:「企業應該擁有我的資料嗎?」(他們已經擁有)。

真正的問題是: 「我的數據是否應該用於為所有人打造更優質的人工智慧?」

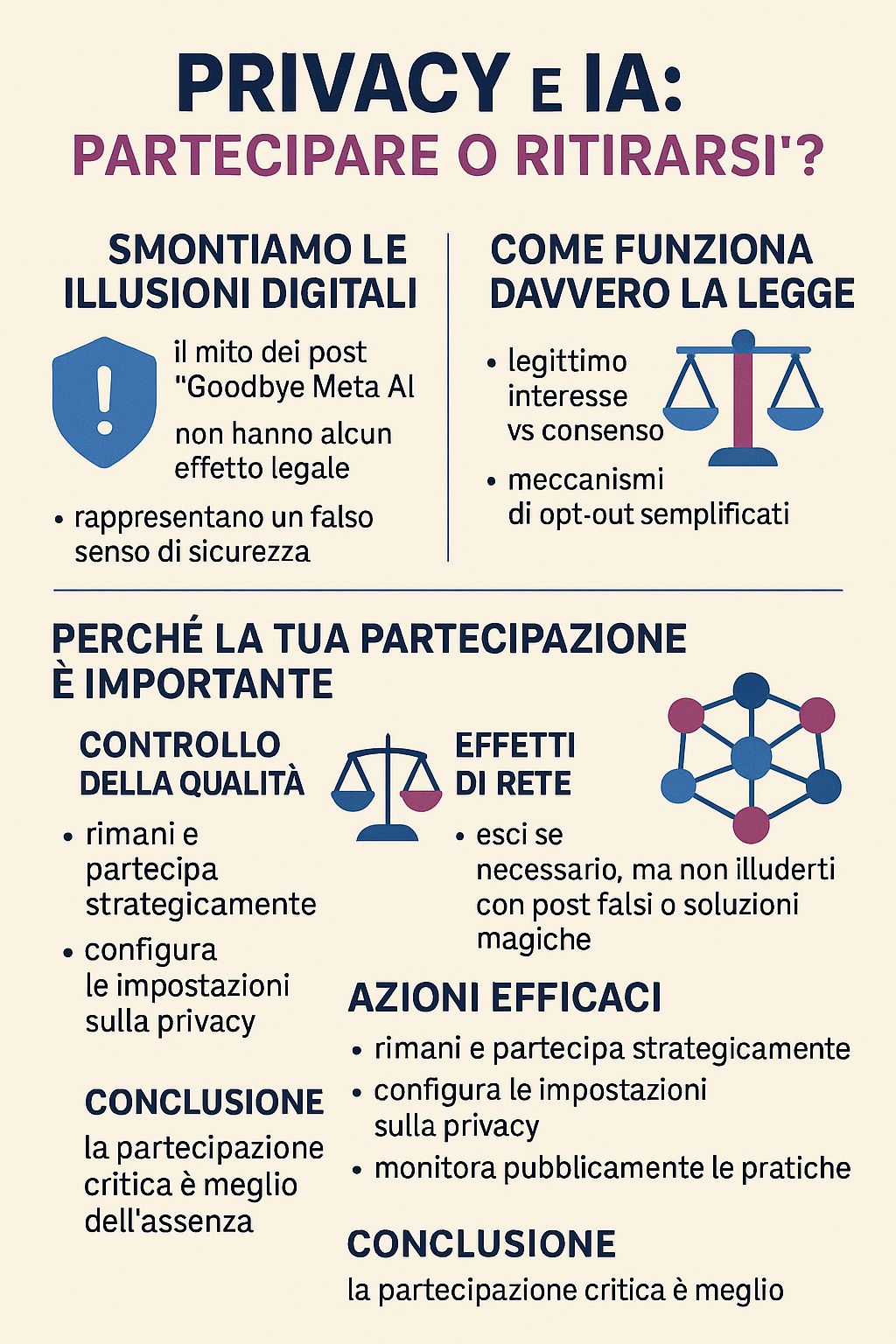

在構建嚴謹論證之前,必須先破除社交媒體上流傳的危險迷思:那些承諾只需分享訊息就能保護你數據的「Goodbye Meta AI」病毒式貼文。

令人不安的事實:這些貼文完全是虛假的,而且可能讓你更容易受到傷害。

正如Meta自身所解釋的,「分享『Goodbye Meta AI』訊息並不構成有效的反對形式」。這些貼文:

這些貼文的病毒式傳播揭示了一個更深層的問題:我們寧願選擇簡單而虛幻的解決方案,也不願做出複雜而明智的決定。分享貼文讓我們感覺自己積極參與其中,卻無需費心真正理解數位權利的運作機制。

但隱私無法靠迷因來捍衛。它需要透過知識與有意識的行動來守護。

自2025年5月31日起,Meta已實施一項以「合法利益」而非同意作為法律依據的人工智慧訓練新制度。此舉並非規避手段,而是《通用資料保護條例》所允許的合法工具。

合法利益允許企業在未獲明確同意的情況下處理數據,前提是企業能證明其利益不凌駕於用戶權利之上。這形成了一個灰色地帶,企業可透過內部評估「量身定制法律」。

使用未經匿名化的數據會帶來「模型逆轉、記憶洩漏及提取漏洞等高風險」。所需的運算能力意味著只有具備極高能力的行為者才能有效利用這些數據,從而造成公民與大型企業之間的系統性不對稱。

既然我們已經釐清了法律與技術層面的現實,現在就來構建戰略參與的論點。

當有意識的人們放棄時,人工智慧便以剩餘者為訓練對象。您是否希望人工智慧系統主要基於以下人群的數據:

人工智慧中的偏見發生於訓練數據缺乏代表性時。您的參與有助於確保:

人工智慧系統隨著規模與多樣性的增加而進步:

若您使用基於人工智慧的功能(搜尋、翻譯、推薦、無障礙工具),您的參與將有助於改善這些功能,使所有使用者(包括未來最需要這些功能的使用者)都能受益。

無論選擇加入或退出人工智慧服務,您的隱私權皆不會產生顯著變化。相同資料已持續提供給:

關鍵差異在於這些數據是否同時有助於提升所有人的AI體驗,抑或僅服務於平台的短期商業利益。

這正是像你這樣負責任的人應該參與的原因。退縮並不能阻止人工智慧的發展,只會讓你在其中失去發言權。

人工智慧系統終將被開發出來。問題在於:這些系統的開發過程,究竟會不會包含那些對這些議題進行批判性思考的人們所提供的貢獻?

可以理解。但請考慮這一點:你更希望人工智慧系統是在 有或沒有 那些與你同樣對大企業持懷疑態度的人的參與下建構的?

你的不信任正是你批判性參與如此珍貴的原因。

人工智慧正在成為現實,無論你是否參與其中。

你的選擇並非在於人工智慧是否會被建造,而在於即將被建造的人工智慧是否能反映那些認真思考這些議題的人們的價值觀與觀點。

選擇退出就像不投票。這並不會阻止選舉,只意味著結果不會計入你的貢獻。

在一個唯有具備極高運算能力的參與者才能有效解讀與運用這些數據的世界裡,你在訓練過程中的批判性聲音,其影響力可能遠勝於你的缺席。

若符合以下情況,請留下來並採取策略性參與:

與此同時:

但別被以下想法所迷惑:

您的個人退出對您的隱私影響甚微,但留下來卻會對所有人產生實質影響。

在一個由人工智慧系統主導資訊流、決策過程以及人與科技互動的世界裡,問題不在於這些系統是否應該存在,而在於它們是否應納入像你這樣善於思考且具批判精神的觀點。

有時,最激進的行動並非放棄。往往,最激進的方式是堅守立場,確保自己的聲音被聽見。

匿名

這並非意味著要盲目信任企業或忽視隱私相關疑慮。而是要認識到,隱私的捍衛並非依靠網路迷因,而是透過策略性且有意識的參與來實現。

在權力嚴重失衡的生態系統中,你在人工智慧訓練過程中提出批判性意見的影響力,可能遠勝於你以缺席作為抗議的態度。

無論你的選擇為何,請以覺知來選擇,而非憑藉數位幻象。

對「隱私隱士」們也抱持同情——那些純潔的靈魂,自以為能像2025年的西藏僧侶般離線生活,從而完全逃離數位追蹤。

劇透:即使你搬到多洛米蒂山脈的偏僻山屋居住,你的數據早已無所不在。你的家庭醫生使用數位系統;你存錢買柴火的銀行追蹤每筆交易;鄉村超市裝設攝影機與電子支付系統;甚至送帳單的郵差,也為物流數據庫貢獻資料,這些資料正是優化演算法的養分。

2025年實現完全的數位隱居,本質上意味著自我排除於文明社會之外。你可以放棄Instagram,但無法放棄醫療、銀行、教育或工作體系而不對生活品質造成劇烈衝擊。

當你忙著搭建你的反5G小屋時,你的數據依然存在於醫院、銀行、保險公司、市政廳、稅務機關的資料庫中,並持續被用來訓練那些將影響未來世代的系統。

隱士的悖論:你抗議式的自我隔離,並不能阻止人工智慧系統利用那些較不自覺者的數據進行訓練,反而使你喪失了將其發展引導至更符合倫理方向的可能性。

說穿了,你贏得了那種從看台觀望歷史的人所具備的純粹道德潔淨,而其他人——較不明智卻更積極參與——則在制定遊戲規則。

無論你的選擇為何,請以覺知來選擇,而非憑藉數位幻象。

引用文章:

深入解析GDPR與合法利益:

官方資源:

具體行動:若您身處歐洲,請向隱私權監管機構查詢官方退出程序。如需一般資訊,請參閱您所使用平台的隱私權設定與服務條款。請注意:任何社群媒體貼文均不具法律效力。